Fine-tuning 入門:什麼時候需要訓練自己的 AI 模型

Fine-Tuning 101: When You Actually Need to Train Your Own AI Model

ファインチューニング入門:自分のAIモデルを訓練すべき時とは

Prompt 工程、RAG、Fine-tuning 各有適用場景,選對方法才能事半功倍。

Prompt engineering, RAG, and fine-tuning each solve different problems. Choosing the right one saves time, money, and headaches.

プロンプト設計・RAG・ファインチューニングの使い分けを理解し、最適な技術選定を行おう。

這是《AI 工具實戰 30 天》系列第 26 篇,共 30 篇。當你開始認真使用 AI 工具,遲早會遇到一個問題:「我到底該用 Prompt 工程、RAG,還是 Fine-tuning?」這三種方法聽起來都能讓 AI 表現更好,但適用場景截然不同。選錯方法,不只浪費時間,還可能花大錢卻得不到預期效果。本篇就來幫你釐清這三者的邊界,讓你在技術選型時不再迷茫。

This is Part 26 of 30 in the AI Tools in Action series. Once you start using AI seriously, you’ll hit a familiar crossroads: should I use prompt engineering, RAG, or fine-tuning? All three can improve AI performance, but they solve fundamentally different problems. Pick the wrong one and you’re burning time and budget for underwhelming results. This article draws clear lines between the three so you can make confident technical decisions.

これは「AIツール実践30日間」シリーズの第26回(全30回)です。AIを本格的に活用し始めると、必ずこんな疑問にぶつかります。「プロンプトエンジニアリング、RAG、ファインチューニング、どれを使えばいいのか?」この3つはどれもAIのパフォーマンスを向上させる手法ですが、適用すべき場面はまったく異なります。間違った選択をすると、時間とコストを無駄にするだけでなく、期待した成果も得られません。本記事では3つの手法の境界線を明確にし、技術選定に迷わないための指針を提供します。

Prompt 工程:最快、最便宜的第一選擇Prompt Engineering: Your Fastest, Cheapest First Moveプロンプトエンジニアリング:最速・最安のファーストチョイス

Prompt 工程是調整你給 AI 的指令,讓模型在不改變本身的情況下輸出更符合需求的結果。它的優點是零成本、即時生效,適合大多數日常任務。當你的需求是「讓 AI 用特定語氣回答」、「遵循某種格式輸出」或「處理通用知識問題」,Prompt 工程幾乎都能搞定。但它有明顯限制:模型本身不知道你的私有資料,也無法記住跨對話的上下文。如果你發現自己每次都要貼一大段背景資訊,那就是 RAG 登場的時機了。

Prompt engineering means crafting better instructions for the model without changing the model itself. It’s zero-cost, instant, and handles the vast majority of everyday tasks. Need the AI to respond in a specific tone, follow a particular format, or answer general knowledge questions? Prompt engineering covers it. The ceiling hits when the model lacks access to your private data or can’t retain context across sessions. If you find yourself pasting the same background info every single time, that’s your cue to look at RAG.

プロンプトエンジニアリングとは、モデル自体を変えずに指示を工夫することでAIの出力を改善する手法です。コストゼロで即効性があり、日常的なタスクの大半に対応できます。特定のトーンで回答させたい、決まったフォーマットで出力したい、一般的な知識に関する質問に答えさせたい、といった用途ならプロンプト設計で十分です。ただし限界もあります。モデルはあなたの社内データを知らず、会話をまたいだ文脈も保持できません。毎回同じ背景情報を貼り付けているなら、それはRAGを検討するサインです。

RAG:讓 AI 讀你的資料,而不是重新訓練它RAG: Give the Model Your Data Without Retraining ItRAG:再訓練せずにモデルに自社データを読ませる

RAG(Retrieval-Augmented Generation)的核心概念是:在每次對話時,先從你的知識庫撈出相關資料,再把這些資料塞進 Prompt 讓模型參考。這樣模型就能回答關於你公司產品、內部文件或最新資訊的問題,而不需要重新訓練。RAG 適合的場景包括:客服機器人需要查詢產品手冊、法律助理需要搜尋合約條款、研究工具需要引用最新論文。它的成本遠低於 Fine-tuning,資料更新也很靈活。但 RAG 的前提是「資料能被檢索到」,如果你的需求是改變模型的行為模式或語言風格,RAG 就力不從心了。

RAG works by retrieving relevant chunks from your knowledge base at query time and injecting them into the prompt as context. The model then answers using your data without ever being retrained. This is ideal for customer support bots that need product manuals, legal assistants searching contract clauses, or research tools citing recent papers. It’s far cheaper than fine-tuning and easy to update. The catch: RAG only works when the right information can be retrieved. If your goal is changing how the model behaves or speaks, not what it knows, RAG won’t cut it.

RAG(検索拡張生成)は、質問のたびに知識ベースから関連情報を取得し、それをプロンプトに組み込んでモデルに参照させる仕組みです。再訓練なしに自社データを活用できます。製品マニュアルを参照するカスタマーサポートBot、契約条項を検索する法律アシスタント、最新論文を引用する調査ツールなどに最適です。ファインチューニングよりコストが低く、データの更新も柔軟です。ただし、RAGが機能するには「必要な情報が検索で取得できること」が前提です。モデルの振る舞いや文体を変えたい場合には、RAGでは対応できません。

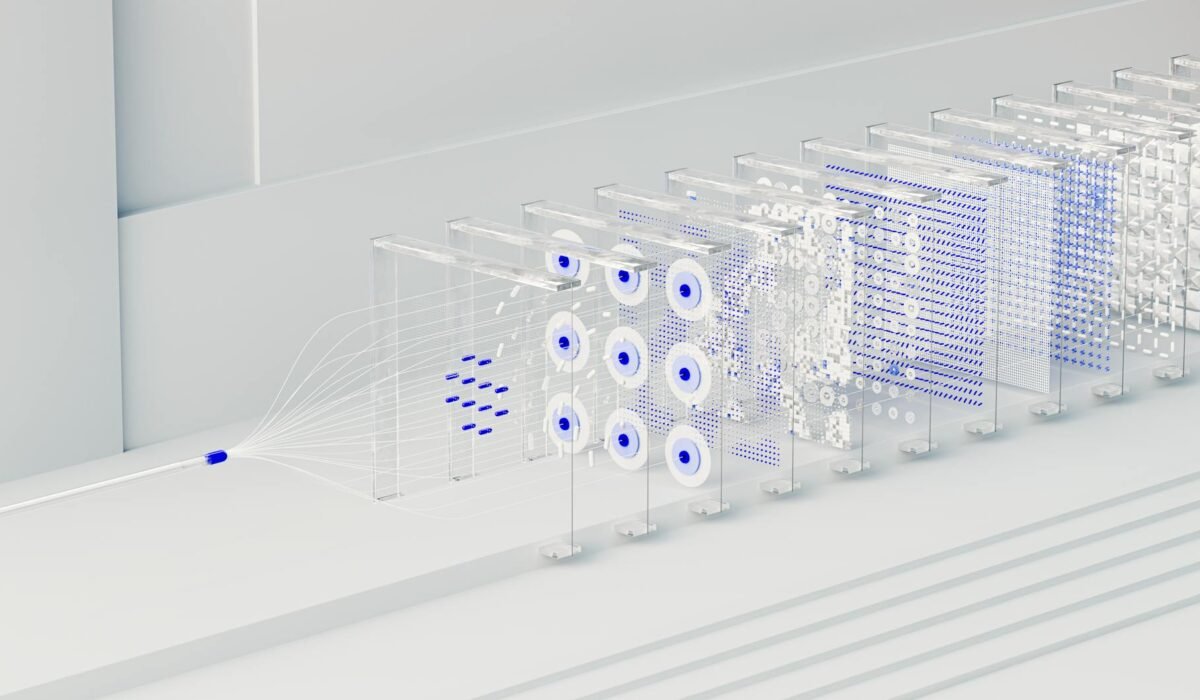

Fine-tuning:真正需要它的三個場景Fine-Tuning: The Three Scenarios Where It Actually Makes Senseファインチューニング:本当に必要な3つのシナリオ

Fine-tuning 是用你的資料繼續訓練模型,讓它從根本上改變行為。它的成本最高、準備時間最長,所以只在以下三種情況才值得考慮:第一,你需要模型掌握高度專業的語言風格,例如特定品牌的語氣、醫療術語或法律文體;第二,你有大量標準化的輸入輸出範例,希望模型穩定複製這種模式;第三,你的應用對延遲極度敏感,無法在每次請求時附帶大量 Prompt 上下文。Fine-tuning 不是萬能藥,它無法讓模型「知道」新知識,只能改變它的行為模式。如果你的問題是知識缺口,RAG 才是正解。

Fine-tuning continues training a model on your data, fundamentally reshaping its behavior. It’s the most expensive and time-consuming option, so it only makes sense in three situations: you need the model to consistently adopt a highly specific style or domain vocabulary; you have a large set of standardized input-output pairs you want reliably reproduced; or your application is latency-sensitive and can’t afford large prompt contexts on every request. One important caveat: fine-tuning doesn’t inject new knowledge into the model. It changes behavior, not facts. If you have a knowledge gap, RAG is still the right answer.

ファインチューニングは自社データでモデルをさらに訓練し、その振る舞いを根本から変える手法です。コストと準備時間が最も大きいため、以下の3つの場面でのみ検討する価値があります。特定のブランドトーン・医療用語・法律文体など高度に専門的なスタイルを安定して出力させたい場合。大量の標準化された入出力ペアがあり、そのパターンを確実に再現させたい場合。レイテンシに敏感なアプリケーションで、毎回大量のプロンプトコンテキストを付与できない場合。重要な注意点として、ファインチューニングはモデルに新しい知識を与えるものではありません。行動パターンを変えるだけです。知識のギャップが問題なら、RAGが正解です。

選型決策樹:三步驟找到正確方法A Simple Decision Tree: Three Steps to the Right Choice選択のデシジョンツリー:3ステップで正しい手法を見つける

面對技術選型,可以用這個簡單邏輯:第一步,先試 Prompt 工程,如果能解決就不需要更複雜的方案。第二步,如果問題是「模型不知道我的資料」,選 RAG。第三步,如果問題是「模型的行為或風格不符合需求,且 Prompt 調整已無法改善」,才考慮 Fine-tuning。大多數人在第一步就能解決問題,少數人需要 RAG,真正需要 Fine-tuning 的場景其實相當罕見。記住這個順序,能幫你省下大量不必要的成本與時間。

上一篇:本地部署 AI:用 Ollama 在自己的電腦跑大型語言模型

下一篇(第27篇):AI 工具的成本控制:如何在預算內最大化 AI 效益

Here’s a practical decision tree. Step one: try prompt engineering first. If it works, you’re done. Step two: if the problem is that the model doesn’t know your data, use RAG. Step three: if the model’s behavior or style is fundamentally off and prompt tuning can’t fix it, then consider fine-tuning. Most problems get solved at step one. A smaller set needs RAG. Fine-tuning is genuinely rare in practice. Following this order will save you significant time and money.

Previous: Local AI Deployment: Running Large Language Models on Your Own Computer with Ollama

Next up (Part 27): AI Cost Control: How to Maximize AI Value Within Your Budget

技術選定には、このシンプルなロジックを使いましょう。ステップ1:まずプロンプトエンジニアリングを試す。解決できればそれで十分です。ステップ2:「モデルが自社データを知らない」が問題なら、RAGを選ぶ。ステップ3:「モデルの振る舞いやスタイルが根本的に合わず、プロンプト調整でも改善できない」場合に初めてファインチューニングを検討する。ほとんどの問題はステップ1で解決します。一部がRAGを必要とし、ファインチューニングが本当に必要なケースは実際にはかなり稀です。この順序を守ることで、不要なコストと時間を大幅に節約できます。

前回:ローカルAIデプロイ:OllamaでPC上で大規模言語モデルを動かす

次回(第27回):AIツールのコスト管理:予算内でAIの効果を最大化する方法