RAG vs Fine-tuning:企業導入 LLM 的選擇框架

RAG vs Fine-tuning: How Enterprises Should Choose When Deploying LLMs

RAG vs ファインチューニング:企業がLLM導入時に正しい選択をするには

2026年企業導入LLM已是常態,但RAG與Fine-tuning的選擇仍讓許多團隊陷入困惑。本文提供清晰的決策框架。

In 2026, deploying LLMs is standard practice, but choosing between RAG and fine-tuning still trips up many teams. Here’s a clear decision framework.

2026年、LLM導入は当たり前になったが、RAGとファインチューニングの選択に迷う企業は多い。明確な判断軸を提示する。

2026年的LLM部署現實The LLM Deployment Reality in 20262026年のLLM導入の現実

到2026年,超過70%的Fortune 500企業已在核心業務流程中整合LLM。問題不再是「要不要用AI」,而是「怎麼用才對」。RAG與Fine-tuning是兩條截然不同的路,選錯了不只浪費預算,還可能讓系統上線後表現令人失望。

By 2026, over 70% of Fortune 500 companies have integrated LLMs into core workflows. The question is no longer whether to use AI, but how to use it correctly. RAG and fine-tuning represent two fundamentally different paths — choosing wrong wastes budget and leads to disappointing production performance.

2026年までに、Fortune 500企業の70%以上がコアワークフローにLLMを統合した。問題はもはや「AIを使うか否か」ではなく、「どう使うか」だ。RAGとファインチューニングは根本的に異なるアプローチであり、誤った選択はコスト浪費と本番環境での失敗につながる。

RAG 是什麼,它解決什麼問題What RAG Is and What Problem It SolvesRAGとは何か、何を解決するのか

RAG(Retrieval-Augmented Generation)讓模型在生成回答前,先從外部知識庫檢索相關資料。它的核心優勢是「知識可更新」——不需要重新訓練模型,只要更新資料庫就能讓AI掌握最新資訊。這對需要即時性的企業場景極為關鍵。

RAG lets a model retrieve relevant information from an external knowledge base before generating a response. Its core advantage is updatable knowledge — you update the database, not the model. For enterprise use cases requiring real-time accuracy, this is a game-changer.

RAGは、モデルが回答を生成する前に外部ナレッジベースから関連情報を検索する仕組みだ。最大の強みは「知識の更新可能性」——モデルを再学習せずにデータベースを更新するだけで最新情報を反映できる。リアルタイム性が求められる企業ユースケースに特に有効だ。

Fine-tuning 是什麼,它的真正用途What Fine-tuning Is and When It Actually Makes Senseファインチューニングとは何か、本当に有効な場面

Fine-tuning是用特定領域的資料對預訓練模型進行再訓練,讓模型「內化」特定的語氣、格式或專業知識。它不是讓模型學習新事實,而是調整模型的行為模式。很多企業誤用Fine-tuning來注入知識,這是最常見的錯誤。

Fine-tuning retrains a pre-trained model on domain-specific data, internalizing a particular tone, format, or behavioral pattern. It’s not about teaching the model new facts — it’s about shaping how it responds. The most common enterprise mistake is using fine-tuning to inject knowledge, which it was never designed to do.

ファインチューニングは、特定ドメインのデータで事前学習済みモデルを再学習し、特定のトーン・フォーマット・行動パターンを内在化させる手法だ。新しい事実を教えるためではなく、応答スタイルを調整するためのものだ。知識注入にファインチューニングを使う誤用が企業で最も多く見られる。

核心差異:一張表說清楚Core Differences at a Glance核心的な違いを整理する

- 知識更新頻率高 → RAG 勝出;知識相對靜態 → Fine-tuning 可考慮

- 需要引用來源、可追溯性 → RAG 天然支援;黑盒輸出可接受 → Fine-tuning 無礙

- 預算有限、快速上線 → RAG 成本更低;需要特定輸出格式或語氣 → Fine-tuning 更精準

- 資料含敏感資訊、不能進入訓練集 → RAG 更安全

- High knowledge update frequency → RAG wins; relatively static knowledge → fine-tuning is viable

- Need source citations and traceability → RAG supports this natively; black-box output acceptable → fine-tuning works

- Limited budget, fast deployment → RAG is cheaper; specific output format or tone required → fine-tuning is more precise

- Data contains sensitive information that cannot enter training sets → RAG is safer

- 知識の更新頻度が高い → RAGが有利;知識が比較的静的 → ファインチューニングを検討可

- 出典引用・追跡可能性が必要 → RAGがネイティブ対応;ブラックボックス出力でも可 → ファインチューニングで問題なし

- 予算が限られ迅速な展開が必要 → RAGがコスト効率的;特定の出力形式やトーンが必要 → ファインチューニングがより正確

- 機密情報を含むデータを学習データに含められない → RAGの方が安全

我的觀點:大多數企業應該先選 RAGMy Take: Most Enterprises Should Start with RAG私の見解:ほとんどの企業はまずRAGから始めるべき

在2026年的市場環境下,我認為90%的企業初期應該選擇RAG。原因很簡單:企業的知識庫每天都在變化,法規更新、產品迭代、市場資訊——這些都不適合燒進模型權重裡。RAG讓你保持靈活,Fine-tuning讓你承擔技術債。

In the 2026 market environment, I’d argue 90% of enterprises should start with RAG. The reason is simple: enterprise knowledge changes daily — regulations, product updates, market data. None of that belongs baked into model weights. RAG keeps you agile; fine-tuning creates technical debt.

2026年の市場環境において、企業の90%はまずRAGから始めるべきだと私は考える。理由はシンプルだ。企業の知識は毎日変化する——規制、製品更新、市場データ。これらをモデルの重みに焼き込むべきではない。RAGは俊敏性を保ち、ファインチューニングは技術的負債を生む。

「Fine-tuning 教模型怎麼說話,RAG 告訴模型說什麼。大多數企業需要的是後者。」“Fine-tuning teaches a model how to speak. RAG tells it what to say. Most enterprises need the latter.”「ファインチューニングはモデルに話し方を教え、RAGは何を話すかを伝える。ほとんどの企業が必要としているのは後者だ。」

Fine-tuning 真正發光的場景Where Fine-tuning Actually Shinesファインチューニングが真に輝く場面

Fine-tuning並非無用,它在特定場景下不可替代:需要高度一致的輸出格式(如法律文件、醫療報告)、需要模型掌握特定行業術語的使用習慣、或是需要壓縮推理成本時(Fine-tuned的小模型可以比大模型+RAG更便宜)。2026年許多垂直SaaS公司正是靠Fine-tuning建立護城河。

Fine-tuning isn’t useless — it’s irreplaceable in specific scenarios: highly consistent output formats like legal or medical documents, internalizing industry-specific terminology usage, or reducing inference costs where a fine-tuned small model beats a large model with RAG on price. In 2026, many vertical SaaS companies are building moats precisely through fine-tuning.

ファインチューニングが無用というわけではない。特定の場面では不可欠だ。法律文書や医療レポートのような高度に一貫した出力形式、業界固有の専門用語の使い方の内在化、または推論コスト削減(ファインチューニング済み小型モデルがRAG付き大型モデルよりコスト効率が良い場合)。2026年、多くの垂直SaaS企業はファインチューニングで競争優位を築いている。

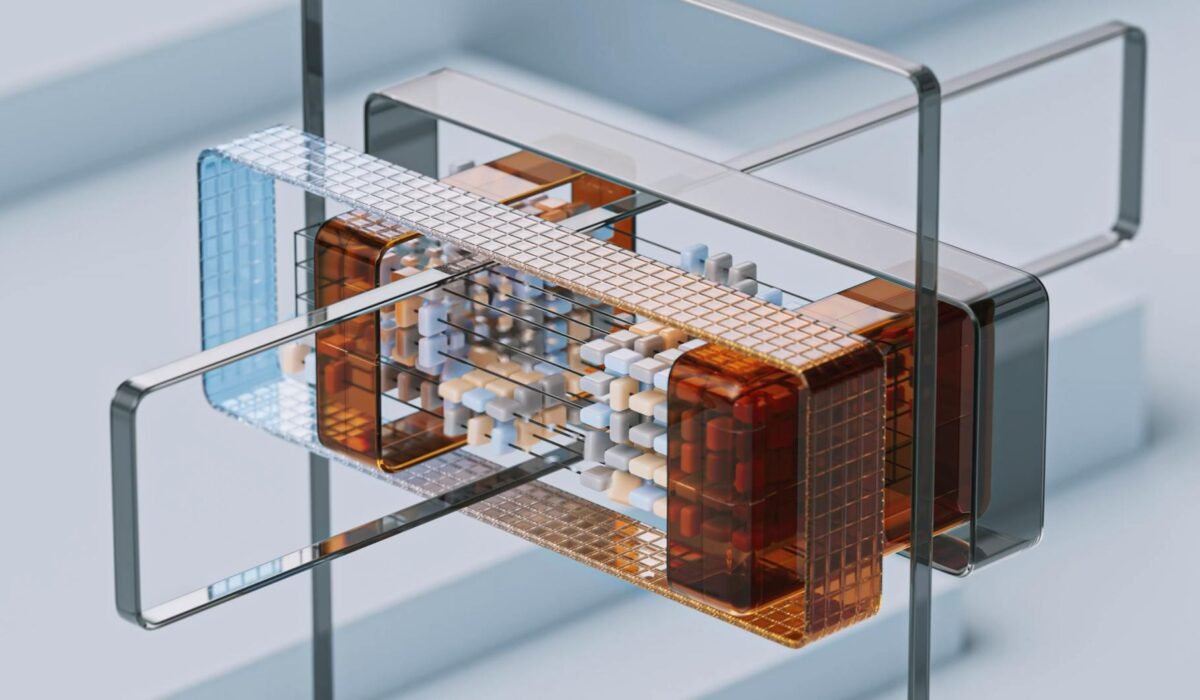

混合策略:2026年的主流選擇The Hybrid Strategy: The 2026 Mainstream Approachハイブリッド戦略:2026年のメインストリーム

最成熟的企業AI架構已不是非此即彼,而是「Fine-tuning定義行為 + RAG注入知識」的組合。例如:先Fine-tune一個模型讓它以公司語氣回應,再用RAG接入即時產品資料庫。這個組合在2026年已成為金融、醫療、法律等高合規行業的標準架構。

The most mature enterprise AI architectures in 2026 aren’t either/or — they combine fine-tuning to define behavior with RAG to inject knowledge. For example: fine-tune a model to respond in your company’s tone, then connect it to a live product database via RAG. This combination has become the standard architecture in high-compliance industries like finance, healthcare, and legal.

2026年の最も成熟した企業AIアーキテクチャは二択ではない。「ファインチューニングで行動を定義し、RAGで知識を注入する」組み合わせだ。例えば、企業のトーンで応答するようモデルをファインチューニングし、RAGでリアルタイムの製品データベースに接続する。この組み合わせは金融・医療・法律などの高コンプライアンス業界で標準アーキテクチャとなっている。

決策流程:三個問題幫你選對Decision Flow: Three Questions to Guide Your Choice意思決定フロー:選択を導く3つの質問

- 你的知識庫多久更新一次?超過每月一次 → 強烈建議RAG

- 你需要模型輸出特定格式或語氣嗎?是 → Fine-tuning值得投資

- 你有足夠的高品質標注資料嗎?沒有 → Fine-tuning效果會很差,先做RAG

- How often does your knowledge base update? More than once a month → strongly recommend RAG

- Do you need the model to output a specific format or tone? Yes → fine-tuning is worth the investment

- Do you have sufficient high-quality labeled data? No → fine-tuning will underperform, start with RAG

- ナレッジベースはどのくらいの頻度で更新されるか?月1回以上 → RAGを強く推奨

- モデルに特定のフォーマットやトーンで出力させる必要があるか?はい → ファインチューニングへの投資は価値がある

- 十分な高品質なラベル付きデータがあるか?ない → ファインチューニングは効果が低い、まずRAGから始めよ

常見陷阱與我見過的真實失敗案例Common Pitfalls and Real Failures I’ve Seenよくある落とし穴と実際の失敗事例

2025至2026年間,我觀察到最多的失敗模式是:企業花了三個月Fine-tuning模型,上線後發現模型「記住了舊資料」卻無法回答新問題。另一個常見錯誤是RAG的chunk策略太差,導致檢索結果不相關,最後被誤判為「RAG不好用」。工具選對了,但實作細節決定成敗。

Between 2025 and 2026, the most common failure pattern I’ve observed: enterprises spend three months fine-tuning, then discover the model ‘memorized old data’ but can’t answer new questions. Another frequent mistake is poor RAG chunking strategy, leading to irrelevant retrieval results and the false conclusion that ‘RAG doesn’t work.’ The tool choice matters, but implementation details decide the outcome.

2025〜2026年にかけて最も多く見られた失敗パターン:企業が3ヶ月かけてファインチューニングした後、モデルが「古いデータを記憶している」が新しい質問に答えられないと判明するケース。もう一つの頻繁なミスは、RAGのチャンク戦略が不適切で検索結果が無関係になり、「RAGは使えない」という誤った結論に至ること。ツール選択も重要だが、実装の詳細が成否を決める。

成本考量:2026年的市場行情Cost Considerations: 2026 Market Ratesコスト考慮:2026年の市場相場

2026年Fine-tuning成本已大幅下降,GPT-4級別模型的Fine-tuning費用約為2024年的40%。但RAG的向量資料庫成本也同步下降,Pinecone、Weaviate等服務的企業方案更具競爭力。純成本角度,兩者差距縮小,但RAG的維護成本(資料更新、索引管理)仍需納入TCO計算。

By 2026, fine-tuning costs have dropped significantly — GPT-4-class model fine-tuning runs about 40% of 2024 prices. But RAG vector database costs have also fallen, with enterprise plans from providers like Pinecone and Weaviate becoming more competitive. The cost gap has narrowed, but RAG’s ongoing maintenance costs — data updates, index management — still need to factor into your TCO calculation.

2026年までにファインチューニングのコストは大幅に低下し、GPT-4クラスのモデルのファインチューニングは2024年比約40%のコストになった。しかしRAGのベクターデータベースコストも同様に低下し、PineconeやWeaviateなどのエンタープライズプランはより競争力を持つ。コスト差は縮まったが、RAGの継続的なメンテナンスコスト(データ更新、インデックス管理)はTCO計算に含める必要がある。

結論:沒有萬能答案,但有清晰框架Conclusion: No Universal Answer, But a Clear Framework結論:万能な答えはないが、明確なフレームワークはある

RAG vs Fine-tuning不是技術競賽,而是業務需求的映射。2026年的企業AI成熟度已經足夠讓我們說:先用RAG快速驗證價值,再用Fine-tuning打磨體驗,最終走向混合架構。不要讓技術選型的糾結拖慢你的AI落地速度——先動起來,再優化。

RAG vs fine-tuning isn’t a technical competition — it’s a mapping of business requirements. Enterprise AI maturity in 2026 is sufficient to say: start with RAG to validate value quickly, use fine-tuning to polish the experience, and evolve toward a hybrid architecture. Don’t let the paralysis of technical choice slow down your AI deployment — move first, optimize later.

RAG対ファインチューニングは技術競争ではなく、ビジネス要件のマッピングだ。2026年の企業AIの成熟度は十分に高く、こう言える:まずRAGで価値を素早く検証し、ファインチューニングで体験を磨き、最終的にハイブリッドアーキテクチャへと進化させよ。技術選択の迷いでAI導入スピードを落とすな——まず動き、後で最適化せよ。

本文觀點基於2025-2026年企業LLM導入案例分析,以及Gartner 2026 AI Hype Cycle報告、a16z Enterprise AI Survey 2026等公開研究資料。