Google Gemma 4 深度評測:本地 AI 模型真的能取代雲端 API 嗎?

Google Gemma 4 Deep Dive: Can Local AI Models Really Replace Cloud APIs?

Google Gemma 4 徹底レビュー:ローカルAIモデルはクラウドAPIの代替になれるか?

從代碼生成到長文推理,全面測試 Gemma 4 的真實能力,並提供本地模型 vs 雲端 API 的決策框架。

From code generation to long-context reasoning, we benchmark Gemma 4’s real-world capabilities and offer a practical framework for choosing local models over paid APIs.

コード生成から長文推論まで、Gemma 4の実力を徹底検証。ローカルモデルとクラウドAPIの使い分け判断基準も解説します。

Gemma 4 是什麼?2026 年的本地 AI 新基準What Is Gemma 4? The New Local AI Benchmark in 2026Gemma 4とは?2026年のローカルAI新基準

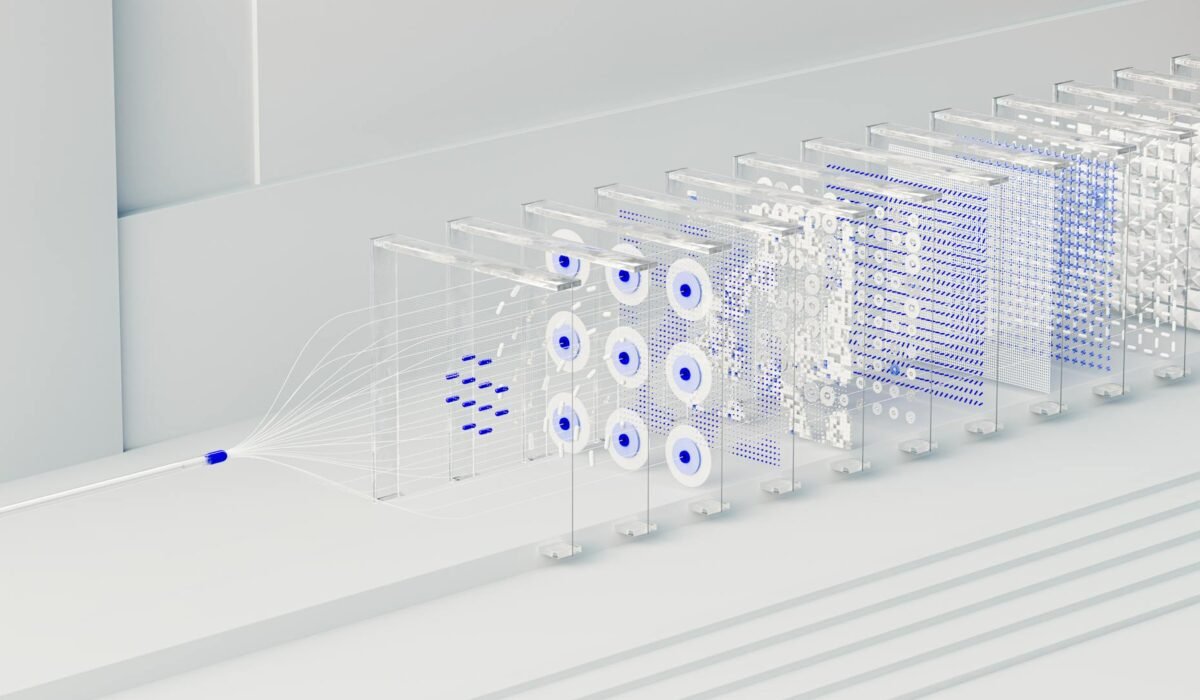

Google 於 2025 年底發布 Gemma 4,2026 年初已成為開源本地模型的主流選擇。它提供 4B 到 27B 多種參數版本,支援 128K 上下文窗口,並針對消費級 GPU 做了大量優化,讓普通開發者也能在本機流暢運行。

Released in late 2025, Gemma 4 has become the go-to open-source local model by early 2026. It offers variants from 4B to 27B parameters, supports a 128K context window, and is heavily optimized for consumer GPUs — making it genuinely accessible for everyday developers.

2025年末にリリースされたGemma 4は、2026年初頭にはオープンソースローカルモデルの主流となりました。4Bから27Bまでのパラメータ版を提供し、128Kコンテキストウィンドウに対応。コンシューマー向けGPUでも快適に動作します。

代碼生成測試:Gemma 4 vs GPT-4oCode Generation Test: Gemma 4 vs GPT-4oコード生成テスト:Gemma 4 vs GPT-4o

在 Python、TypeScript 和 SQL 的代碼生成測試中,Gemma 4 27B 的表現令人驚喜。常規函數、API 整合、單元測試生成的準確率達到 GPT-4o 的 85-90%。但面對複雜的多文件重構任務,差距仍然明顯,GPT-4o 的上下文理解更為連貫。

In Python, TypeScript, and SQL benchmarks, Gemma 4 27B is surprisingly competitive — hitting 85–90% of GPT-4o’s accuracy on routine functions, API integrations, and unit test generation. The gap widens on complex multi-file refactoring, where GPT-4o’s contextual coherence still leads.

Python、TypeScript、SQLのコード生成テストでは、Gemma 4 27Bは驚くほど健闘。通常の関数やAPIインテグレーション、ユニットテスト生成ではGPT-4oの85〜90%の精度を達成。ただし複数ファイルのリファクタリングでは差が開きます。

文本分析與摘要能力Text Analysis and Summarizationテキスト分析と要約能力

Gemma 4 在文本摘要、情感分析和關鍵信息提取方面表現穩定。處理 10,000 字以內的文件時,摘要質量接近商業模型。但在需要跨段落推理或識別隱含邏輯的任務上,仍有明顯的幻覺問題,需要額外的提示工程來緩解。

Gemma 4 performs solidly on summarization, sentiment analysis, and key information extraction. For documents under 10,000 words, summary quality is close to commercial models. However, tasks requiring cross-paragraph inference or implicit logic detection still show noticeable hallucination issues that need prompt engineering to mitigate.

Gemma 4は要約、感情分析、重要情報抽出で安定したパフォーマンスを発揮。1万字以内の文書では商用モデルに近い品質を実現。ただし段落をまたぐ推論や暗黙的な論理の検出では、まだハルシネーションが見られます。

多語言處理:中文、日文、英文表現如何?Multilingual Performance: Chinese, Japanese, and English多言語処理:中国語・日本語・英語の実力は?

英文表現最強,中文次之,日文在語法複雜度高的句子上偶有錯誤。值得注意的是,Gemma 4 的多語言能力在 2026 年的版本中有顯著提升,特別是中文的指令跟隨能力,已能處理大多數商業場景的需求。

English performance is strongest, followed by Chinese. Japanese shows occasional errors in grammatically complex sentences. Notably, Gemma 4’s multilingual capabilities saw significant improvement in its 2026 release — Chinese instruction-following in particular now handles most commercial use cases reliably.

英語が最も強く、中国語がそれに続きます。日本語は文法的に複雑な文で時折エラーが発生。ただし2026年版では多言語能力が大幅に向上しており、中国語の指示追従は商業用途の大半に対応できるレベルです。

長文推理:128K 上下文的真實表現Long-Context Reasoning: How Real Is the 128K Window?長文推論:128Kコンテキストの実力

128K 上下文在理論上很吸引人,但實測發現,當輸入超過 60K tokens 時,Gemma 4 的推理準確率開始下降,尤其是「針在草堆中」類型的信息檢索任務。這是目前本地模型的共同瓶頸,並非 Gemma 4 獨有的問題。

The 128K context window sounds impressive, but in practice, reasoning accuracy starts degrading beyond 60K tokens — especially on needle-in-a-haystack retrieval tasks. This is a shared bottleneck across local models in 2026, not a Gemma 4-specific flaw.

128Kコンテキストは理論上魅力的ですが、実測では60Kトークンを超えると推論精度が低下し始めます。特に「ニードル・イン・ア・ヘイスタック」型の情報検索タスクで顕著。これは2026年のローカルモデル全般に共通する課題です。

本地模型的核心優勢:隱私與離線場景The Core Advantage of Local Models: Privacy and Offline Useローカルモデルの核心的優位性:プライバシーとオフライン利用

- 數據完全不離開本機,適合醫療、法律、金融等高敏感行業

- 無網絡環境下仍可正常運行,適合邊緣計算和現場部署

- 無 API 調用費用,高頻使用場景下成本優勢顯著

- 可完全自定義微調,針對特定業務場景優化模型行為

- Data never leaves your machine — ideal for healthcare, legal, and financial sectors

- Works fully offline, enabling edge computing and on-site deployment scenarios

- Zero API call costs — significant savings for high-frequency usage

- Fully customizable via fine-tuning to optimize for specific business workflows

- データが端末外に出ないため、医療・法律・金融などの高機密業界に最適

- 完全オフラインで動作し、エッジコンピューティングや現場展開に対応

- API呼び出しコストがゼロで、高頻度利用シーンでのコスト優位性が大きい

- ファインチューニングで完全カスタマイズ可能、特定業務フローに最適化できる

何時選擇本地模型?決策框架When to Choose Local Models: A Decision Frameworkローカルモデルを選ぶべき時:意思決定フレームワーク

不是所有場景都適合本地模型。關鍵決策因素包括:數據敏感程度、使用頻率、任務複雜度、硬件資源。如果你的任務需要最高精度且預算充足,雲端 API 仍是首選;但若隱私合規是硬性要求,本地模型是唯一選項。

Not every use case suits a local model. Key decision factors: data sensitivity, usage frequency, task complexity, and available hardware. If you need peak accuracy and have budget, cloud APIs still win. But when privacy compliance is non-negotiable, local is the only real option.

すべてのユースケースにローカルモデルが適しているわけではありません。判断基準はデータの機密性、利用頻度、タスクの複雑さ、ハードウェアリソース。最高精度が必要でコストが許容できるならクラウドAPIが優位。ただしプライバシーコンプライアンスが必須なら、ローカル一択です。

「本地模型不是要取代雲端 API,而是填補雲端 API 無法觸及的場景——那些數據不能出門的地方。」“Local models aren’t here to replace cloud APIs — they fill the gaps where cloud simply can’t go: the places where data must never leave the building.”「ローカルモデルはクラウドAPIを置き換えるものではなく、クラウドが届かない場所——データが外に出てはいけない場所——を埋めるものです。」

硬件需求:你需要什麼配置才能跑 Gemma 4?Hardware Requirements: What Do You Need to Run Gemma 4?ハードウェア要件:Gemma 4を動かすには何が必要?

- Gemma 4 4B:8GB VRAM 即可流暢運行,RTX 3060 以上

- Gemma 4 12B:需要 16GB VRAM,RTX 4080 或 Apple M3 Max

- Gemma 4 27B:需要 24GB+ VRAM 或多 GPU 設置,適合工作站級別

- Gemma 4 4B: runs smoothly on 8GB VRAM, RTX 3060 or equivalent

- Gemma 4 12B: requires 16GB VRAM, RTX 4080 or Apple M3 Max

- Gemma 4 27B: needs 24GB+ VRAM or multi-GPU setup, workstation-grade hardware

- Gemma 4 4B:8GB VRAMで快適動作、RTX 3060以上

- Gemma 4 12B:16GB VRAMが必要、RTX 4080またはApple M3 Max

- Gemma 4 27B:24GB以上のVRAMまたはマルチGPU構成が必要、ワークステーション級

與其他 2026 年主流本地模型的比較Comparison with Other Leading Local Models in 20262026年の主要ローカルモデルとの比較

在 2026 年的本地模型競爭格局中,Gemma 4 面對 Llama 4、Mistral Large 2 和 Qwen 3 的競爭。Gemma 4 的優勢在於 Google 的訓練數據質量和多語言能力;Llama 4 在代碼任務上略勝;Qwen 3 在中文場景下仍有優勢。選擇哪個取決於你的主要使用語言和任務類型。

In 2026’s competitive local model landscape, Gemma 4 faces Llama 4, Mistral Large 2, and Qwen 3. Gemma 4 leads on training data quality and multilingual breadth; Llama 4 edges ahead on coding tasks; Qwen 3 still holds an advantage for Chinese-primary workflows. Your choice depends on language and task type.

2026年のローカルモデル競争では、Gemma 4はLlama 4、Mistral Large 2、Qwen 3と競合。Gemma 4はトレーニングデータの質と多言語対応で優位。コードタスクではLlama 4が若干上回り、中国語特化ではQwen 3が強い。選択は主要言語とタスク次第です。

實際部署建議:Ollama、LM Studio 還是自建服務?Deployment Recommendations: Ollama, LM Studio, or Self-Hosted?実際の展開方法:Ollama、LM Studio、それとも自前サーバー?

個人開發者推薦 Ollama,安裝簡單、API 兼容 OpenAI 格式,遷移成本低。團隊部署可考慮 vLLM 或 LocalAI,支持並發請求和負載均衡。LM Studio 適合非技術用戶的圖形界面需求。2026 年這些工具的成熟度已大幅提升,部署門檻比兩年前低很多。

For individual developers, Ollama is the top pick — easy setup and OpenAI-compatible API means low migration cost. For team deployments, vLLM or LocalAI handle concurrent requests and load balancing well. LM Studio suits non-technical users who prefer a GUI. By 2026, all these tools have matured significantly, lowering the barrier considerably.

個人開発者にはOllamaが最適。セットアップが簡単でOpenAI互換APIにより移行コストが低い。チーム展開にはvLLMやLocalAIが並行リクエストと負荷分散に対応。LM StudioはGUIを好む非技術ユーザー向け。2026年にはこれらのツールが大幅に成熟し、導入障壁が下がっています。

總結:本地模型的定位已經清晰Conclusion: The Role of Local Models Is Now Clearまとめ:ローカルモデルの位置づけが明確になった

Gemma 4 代表了 2026 年本地 AI 模型的最高水準,但它不是雲端 API 的替代品,而是補充。對於隱私敏感、離線需求或高頻低複雜度任務,Gemma 4 是極具競爭力的選擇。對於需要最高精度的複雜推理任務,雲端 API 仍然更可靠。理性的策略是混合使用,而非非此即彼。

Gemma 4 represents the state of the art for local AI in 2026 — but it’s a complement to cloud APIs, not a replacement. For privacy-sensitive, offline, or high-frequency low-complexity tasks, it’s highly competitive. For complex reasoning requiring peak accuracy, cloud APIs remain more reliable. The smart play is a hybrid strategy, not an either-or choice.

Gemma 4は2026年のローカルAIの最高水準を体現していますが、クラウドAPIの代替ではなく補完です。プライバシー重視、オフライン、高頻度・低複雑度タスクでは非常に競争力があります。高精度が必要な複雑な推論ではクラウドAPIが依然として優位。賢い戦略はハイブリッド活用です。

本文基於 2026 年 Gemma 4 公開技術文檔、社群基準測試報告及實際部署測試結果撰寫。